一种面向多元交通流时空数据信息的交通流预测方法

本发明属于交通流预测,具体涉及一种面向多元交通流时空数据信息的交通流预测方法。

背景技术:

1、交通流预测对于许多实际应用都有重要意义,包括交通管理、城市计算、公共安全等。尤其是近年来城市化的进一步进展,居民人均汽车持有量也随之增加,因此交通流预测问题越来越受到专家学者们的重视。交通流预测是对城市道路交通状况进行分析的重要过程,其利用传感器中的历史数据对交通流的信息进行预测,其预测的指标主要包括:单位时间内的交通流量、单位时间内道路网络或检测节点车辆的速度和占用率,以及对道路交通趋势的预测,其目标在于使道路上所有交通工具能够得到合理安排。交通流预测的本质是多元时序预测,然而与其他的多元时序预测任务(例如电力预测,股市预测)相比,交通流预测有着更大的难度,即一方面,城市道路节点的数量众多,结构复杂;另一方面,在繁忙的城市路段进行预测时,由于道路节点之间的强相互影响,路段车流量的波动性,突发事件的不确定性,使得我们在进行交通流预测任务时需要关注大量信息,进一步加剧了交通流预测的困难。

2、如何有效的利用路段本身的过往信息,以及如何更有效的建模路网关系是交通流预测的关键。以往的交通流预测研究通常分为两类,即知识驱动和数据驱动。在交通与运筹学研究中,知识驱动方法通常试图通过排队理论对交通网络进行计算建模,以此来模拟车辆驾驶员在交通中的驾驶行为,然而这种方法不能体现现实交通流复杂性,因此在精度方面不尽人意。

3、随着交通数据量的不断增加,基于数据驱动的机器学习的方法进入了公众的视野。最初,一些包括自回归综合移动平均(arima)和卡尔曼滤波在内的基于机器学习方法,试图将交通流预测建模为一个单纯的时序预测问题,以此来到预测未来交通流的目的,但这种方法基本都严重依赖于平稳相关性的假设,然而这与现实中的交通流实况都是相悖的,更重要的是,与基于知识驱动的方法一样,这些方法都忽略了交通流自身的空间相关性,而这恰恰是交通流预测的关键。

技术实现思路

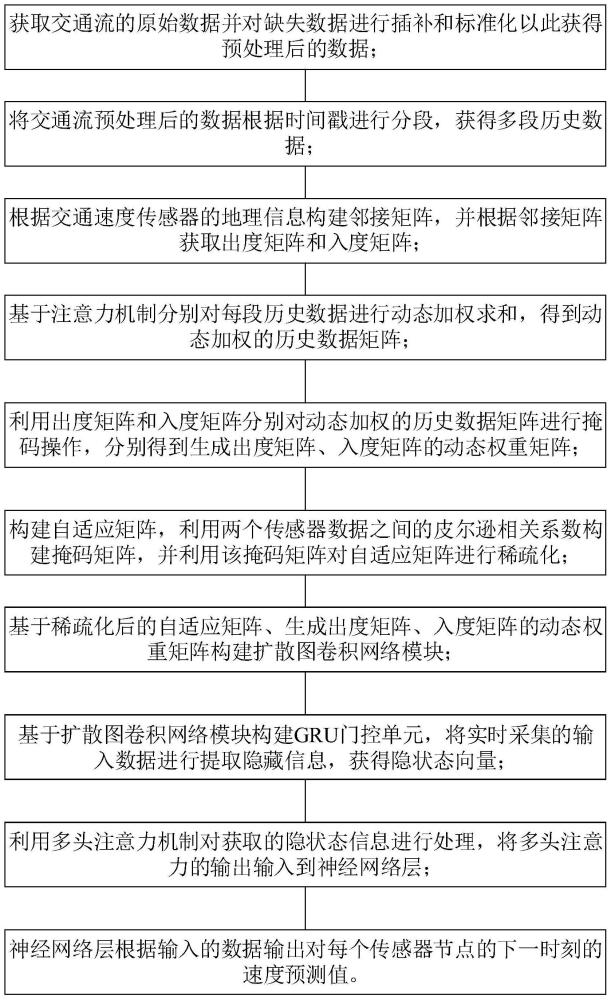

1、针对现有技术存在的不足,本发明提出一种面向多元交通流时空数据信息的交通流预测方法,如图1,具体包括以下步骤:

2、s1、获取交通流的原始数据并对缺失数据进行插补和标准化以此获得预处理后的数据;

3、s2、将交通流预处理后的数据根据时间戳进行分段,将输入数据分为多段;

4、s3、根据交通速度传感器的地理信息构建邻接矩阵,并根据邻接矩阵获取出度矩阵和入度矩阵;

5、s4、基于注意力机制分别对每段输入数据进行动态加权求和,得到动态加权的输入数据矩阵;

6、s5、利用出度矩阵和入度矩阵分别对动态加权的输入数据矩阵进行掩码操作,分别得到生成出度矩阵、入度矩阵的动态权重矩阵;

7、s6、构建自适应矩阵,利用两个传感器数据之间的皮尔逊相关系数构建掩码矩阵,并利用该掩码矩阵对自适应矩阵进行稀疏化;

8、s7、基于稀疏化后的自适应矩阵、生成出度矩阵、入度矩阵的动态权重矩阵构建扩散图卷积网络模块;

9、s8、基于扩散图卷积网络模块构建gru门控单元,将实时采集的输入数据进行提取隐藏信息,获得隐状态向量;

10、s9、利用多头注意力机制对获取的隐状态信息进行处理,将多头注意力的输出输入到神经网络层;

11、s10、神经网络层根据输入的数据输出对每个传感器节点的下一时刻的速度预测值。

12、进一步的,获取交通流的原始数据并对缺失数据进行插补和标准化以此获得预处理后的数据包括:

13、获取交通传感器中每个节点的数据,并将其按时间顺序排列;

14、对于其中的缺失数据,使用平均值法进行插补,即使用缺失数据前一时刻的数据和后一时刻的数据之和的平均值作为替代缺失数据;

15、在完成数据插补后,对数据进行归一化处理,使得所有数据的值都缩放到[-1,1]之间,对数据进行归一化处理的过程包括:

16、

17、其中,x为原始数据的值,mean(x)为所有x的平均值,σ表示数据的标准差,x′即为经过归一化后的缩放数据。

18、进一步的,将交通流预处理后的数据根据时间戳进行分段的过程包括:

19、构建训练数据集时,将历史数据中待预测数据对应的真实数据前一小时数据、前一天同一时段数据以及前一周同一时段数据作为输入,预测待测时间段的数据,并利用预测值与真实数据的差值对预测网络参数进行更新;

20、在实时进行预测时,直接将待预测时间段前一小时数据、前一天同一时段数据以及前一周同一时段数据作为输入,得到预测值。

21、进一步的,根据交通速度传感器的地理信息构建邻接矩阵,并根据邻接矩阵获取交通流出度矩阵和入度矩阵,具体包括:

22、根据传感器的地理位置生成邻接矩阵,即若包括n个传感器,则生成n×n的邻接矩阵,矩阵中第i行、第j列的元素表示第i个传感器是否处于j号传感器的上游位置,若处于则对应矩阵中元素的值为1,否则为0;

23、将当前邻接矩阵作为出度矩阵;

24、对出度矩阵进行转置操作,得到入度矩阵。

25、进一步的,得到生成出度矩阵、入度矩阵的动态权重矩阵的过程包括:

26、aout=softmax(gout⊙attention)

27、ain=softmax(gin⊙attention)

28、其中,aout为出度矩阵的动态权重矩阵;gout为出度矩阵;⊙表示计算哈达玛积,即矩阵对应元素乘积;attention为动态加权的历史数据矩阵;ain为入度矩阵的动态权重矩阵;gin为入度矩阵。

29、进一步的,动态加权的历史数据矩阵的获取包括:

30、

31、qi=xi*wi_q

32、ki=xi*wi_k

33、

34、其中,attention为动态加权的历史数据矩阵;xi表示根据时间戳进行分段后得到的第i段数据;wi表示第i段历史数据xi的权重矩阵,attentioni表示第i段历史数据xi的注意力值;qi表示注意力机制中第i段历史数据xi的查询值矩阵,wi_q为qi对应的查询值权重矩阵;ki表示注意力机制中第i段历史数据xi的键值矩阵,wi_k为ki对应的键值权重矩阵;dk为qi或者ki向量的长度。

35、进一步的,基于出度矩阵、入度矩阵的动态权重矩阵构建自适应矩阵包括:

36、

37、其中,aadp为自适应矩阵;e1、e2为两个可训练的嵌入向量。

38、进一步的,利用两个传感器数据之间的皮尔逊相关系数构建掩码矩阵,并利用该掩码矩阵对自适应矩阵进行稀疏化,即计算各个传感器之间数据的皮尔逊相关系数,若皮尔逊相关系数大于设定阈值则掩码矩阵中这两个传感器对应的位置处值为1,否则为0,利用该掩码矩阵对自适应矩阵进行稀疏化。

39、进一步的,将稀疏化后的自适应矩阵、生成出度矩阵、入度矩阵的动态权重矩阵输入gru门控单元进行提取隐藏信息的过程包括:

40、rt=σ(θr[ht-1,xt])

41、zt=σ(θz[ht-1,xt])

42、

43、

44、其中,rt表示第t时刻重置门得到的数据;zt表示第t时刻更新门中得到的数据;表示候选隐藏状态;ht-1表示第t-1时刻的隐藏状态;xt表示第t时刻时刻的输入,即第t时刻节点采集的交通流数据;θr[ht-1,xt]表示将xt、ht-1拼接后通过重置门中扩散图卷积网络模块θr得到的数据;θz[ht-1,xt]表示将xt、ht-1拼接后通过更新门中扩散图卷积网络模块θz得到的数据;θh[rt*ht-1,xt]表示将xt、rt*ht-1拼接后通过候选层中扩散图卷积网络模块θh得到的数据;若输入数据为x,扩散图卷积网络模块对数据的处理包括:

45、

46、其中,z表示一个扩散图卷积网络模块的输出;m表示扩散次数;表示入度矩阵的动态权重矩阵ain的m次方;表示出度矩阵的动态权重矩阵aout的m次方;为稀疏化后的自适应矩阵的m次方;wk1、wk2、wk3为扩散图卷积网络模块中可训练的权重矩阵。

47、进一步的,利用多头注意力机制对获取的隐状态信息进行处理包括:

48、mhattention(ht)=concat(mhattention(hv),te)

49、mhattention(hv)=concat(head1,head2,...headn)wo

50、

51、

52、te={te1,…,tei,…}

53、其中,mhattention(ht)表示t时刻多头注意力机制的输出;concat(·)表示拼接操作;wo为多头注意力的可训练参数;headi表示第i个头的输出,n为多头注意力中头的总数,h表示隐状态向量,wiq表示第i个头查询向量的可训练权重矩阵,wik表示第i个头键向量的可训练权重矩阵;wiv表示第i个头值向量的可训练权重矩阵;d表示隐状态向量的长度;t为输入数据的长度。

54、本发明通过获取交通流传感器节点中的历史速度数据,将其进行向量化编码。同时通过交通流节点的地理信息,将其转为矩阵向量,并使用门控机制动态调控上下游节点之间的信息交互,同时进行交通节点之间的地理信息融合;另一方面通过生成自适应矩阵并对其稀疏化来获得交通节点之间的隐型信息,对使其进行信息交互,还使用基于rnn的自编码器架构,配合transformer框架,获取节点多段历史信息中的周期性波动特征,最后对未来的交通信息进行预测;本发明通过门控机制和双向图注意力机制,对交通流节点上下游之间的信息进行了更有效更准确的结合,同时利用transformer层,更加有效的提取了交通流的周期性时间特征,实现对多重时间信息的动态融合,进一步提高交通流预测的准确度,同时降低了交通流波动对预测结果的影响。

- 还没有人留言评论。精彩留言会获得点赞!