一种舰船系统多源异构视频处理显示装置及方法与流程

1.本发明属于视频数据处理领域,更具体地,涉及一种舰船系统多源异构视频处理显示装置及方法。

背景技术:

2.舰载显控台是一个多源接入设备,可接入光频/射频、卫通和模拟/数字等制式的信号源,包含了雷达、声呐、红外、光电等在内的各种视频或媒体资源;舰载显控终端需要根据作战系统需求,完成图形与图像视频叠加、图形与雷达视频的融合透明处理、以及标绘层、鼠标层等的多层多窗口的显示。

3.多源异构视频的同窗显示,一般是利用fpga嵌入式平台实现,或者利用cpu算力通过软件编程达到目的。前者不仅要完成雷达扫描转换功能、标绘层鼠标层分离处理、图形与雷达视频的融合透明处理,还要完成多尺寸异步窗口的显示功能。此种方式受限于fpga逻辑资源、时序控制等因素的影响,更多的用来处理较低分辨率、较少路数的视频叠加以及开窗显示。对于2路以上的超高分辨率多源异构视频接入的多窗口融合叠加显示能力显得力不从心,严重影响显示质量以及稳定性;后者计算能力由于全部交由cpu处理,对其算力要求较高,会占用较多的cpu资源,不仅弱化cpu对其它功能的处理能力,同时也会降低多窗口显示的时效性。

技术实现要素:

4.针对现有技术的缺陷,本发明提供了一种舰船系统多源异构视频处理显示装置及方法,相比较于传统方案,本发明不仅能提升显控台同屏视频显示路数以及显示稳定性,也能实现在减少一个编码设备的情况下满足各显控台图形界面网络数据共享的目的。

5.为实现上述目的,本发明提供了一种舰船系统多源异构视频处理显示装置及方法,整体思路为:

6.采用fpga+arm架构模式,充分利用fpga的并行计算以及流水线处理能力,以及arm架构的低功耗高性能特点,不仅能够解决多路超高分辨率无压缩的fc视频(光电视频和雷达视频)和有压缩的网络视频的混合叠加显示功能,提升了其显示质量以及稳定性,也能够保证视频显示的强实时性能。同时由于本发明也可以对融合叠加显示后的输出画面进行同步的编码输出到网络接口以实现数据共享,或通过网络接口接收网络视频流信息进行解码并将其叠加在图形界面上进行显示。更为具体地:

7.一方面,本发明提供了一种舰船系统多源异构视频处理显示装置,包括:协议卸载单元、视频帧格式封装单元、雷达扫描转换单元、图形分配单元、图层分离单元、一次融合叠加单元、二次融合叠加单元、编解码单元和视频综合处理单元;其中,协议卸载单元、视频帧格式封装单元、雷达扫描转换单元、一次融合叠加单元和图层分离单元设置于fpga处理模块上,二次融合叠加单元、编解码单元和视频综合处理单元设置于arm处理模块上;

8.所述协议卸载单元的输入端连接光纤通道,输出端连接视频帧格式封装单元和雷

达扫描转换单元;用于对fc或万兆协议进行解析,获取雷达视频数据和光电视频数据;

9.所述视频帧格式封装单元的输出端连接所述视频综合处理单元,用于对光电视频数据进行重封装得到原始视频层;所述雷达扫描转换单元的输出端连接一次融合叠加单元,用于对雷达视频进行多种模式的扫描转换,并进行各种窗口配置、余辉功能和ppi尾迹功能配置,得到雷达视频层;

10.所述图形分配单元的输入端连接图形输入接口,输出端连接图层分离单元和二次融合叠加单元,用于将输入的视频接口信号并行化处理,一路转化为rgb888颜色空间数据送给图层分离单元,一路转化为yuv422颜色空间数据送到二次融合叠加单元作为图形底层;所述图层分离单元的输出端连接一次融合叠加单元,用于对rgb888颜色空间数据进行图层分离处理,提取出鼠标层和标绘层,同时丢弃海图层数据,以得到鼠标标绘层;

11.所述一次融合叠加单元的输出端与二次融合叠加单元相连,用于将雷达视频层和鼠标标绘层进行融合叠加,以得到一次融合叠加层;所述二次融合叠加单元的输出端连接视频综合处理单元,用于将图形底层与一次融合叠加层再次融合叠加处理,以形成二次融合叠加层;

12.所述编解码单元对外连接以太网通道,对内连接视频综合处理单元;用于接收以太网通道发送过来的视频码流进行解码,将解码后数据送给视频综合处理单元形成压缩视频层;同时用于接收视频综合处理单元送过来的混合窗口输出视频信号,并将其进行编码后通过以太网通道发送出去;

13.所述视频综合处理单元用于对二次融合叠加层、原始视频层以及压缩视频层进行叠加以及开窗显示,形成混合开窗输出视频信号。

14.进一步优选地,所述光纤通道运行基于4.25g/8.5g速率的fc协议,或者基于以太网协议的万兆网络;若光纤通道运行fc协议,则协议卸载单元支持fc-ae-asm协议;若光纤通道运行万兆网协议,则协议卸载单元兼容ieee802.3ae/ap协议。

15.进一步优选地,所述rgb颜色空间数据采用rgb888格式,红绿蓝每种颜色色深8bit,每个像素点由一个24bit数据组成;所述yuv422颜色空间数据为rgb888格式经过颜色空间变换,采用插值法得到的一种yuv422数据格式。

16.进一步优选地,所述图层分离单元提取鼠标层和标绘层的方法为:

17.根据上位机设置的色键值,图层分离单元对rgb888颜色空间数据中每一个rgb888颜色值进行遍历判断,通过查找表的方式,筛选出上位机设定的色键值进行保留,获取鼠标层和标绘层;对不在查找表内的色键值进行数据填0处理,使其表现为黑色像素,从而形成鼠标标绘层。

18.进一步优选地,一次融合叠加单元按照鼠标标绘层信息在上层,雷达视频层信息在下层的原则进行像素值的叠加处理;若在同一像素点上,鼠标标绘层的像素值为m,雷达视频层的像素值为n,则融合后像素点上的像素值为:p=λm+(1-λ)n,0≦λ≦1。

19.进一步优选地,所述二次融合叠加单元对一次融合叠加单元送过来的一次融合叠加层以及图形分配单元送过来的图形底层,按照一次融合叠加层在上层图形底层在下层的顺序进行叠加;叠加规则是一次融合叠加层中的所有黑色像素在二次融合叠加时全部采用图形底层的像素点值替代,而非黑色像素点值保持不变,形成二次融合叠加层。

20.进一步优选地,所述编解码单元用于接收网络视频流信息,同时对多达9路的

1920*1080@30hz分辨率压缩码流进行解码处理,并将解码后的压缩视频层信息发送给视频综合处理单元进行相应的开窗显示;同时用于接收混合窗口输出的画面进行编码处理后送入以太网通道;同时用于根据用户要求通过上位机配置不同编码参数,解码时形成压缩视频层。

21.另一方面,本发明提供了一种舰船系统多源异构视频处理显示方法,包括以下步骤:

22.根据光纤通道的配置情况,对fc或万兆协议进行解析,获取无压缩的原始雷达视频数据和光电视频数据;

23.对光电视频数据进行重封装,形成原始视频层;且对雷达视频进行多种模式的扫描转换,并进行各种窗口配置以及余辉功能和ppi尾迹功能配置,形成雷达视频层;

24.将输入的视频接口信号并行化处理,一路转化为rgb888颜色空间数据,一路转化为yuv422颜色空间数据形成图形底层;

25.对rgb888颜色空间数据进行图层分离处理,提取出鼠标层和标绘层,同时丢弃海图层数据,形成鼠标标绘层;

26.将雷达视频层和鼠标标绘层数据进行第一次融合叠加,鼠标标绘层在上一层,雷达视频层在下一层,形成一次融合叠加层;

27.将图形底层与第一次融合叠加层再次融合叠加处理,二次融合叠加层在上一层,图形底层在下一层,融合后形成二次融合叠加层;

28.同时通过以太网通道接收压缩的网络视频流信息,并对其进行相应的解码,形成压缩视频层;

29.对二次融合叠加层、原始视频层以及压缩视频层进行叠加以及混合开窗显示,其中,二次融合叠加层始终满屏显示,而原始视频层以及压缩视频层则根据上位机指令进行窗口大小以及位置信息的配置进行满屏或非满屏的显示。

30.将混合窗口输出视频信息进行编码,形成网络视频流通过以太网通道发送出去。

31.进一步优选地,第一次融合叠加按照标绘层信息在上层,雷达层信息在下层的原则进行像素值的叠加处理;若在同一像素点上,鼠标标绘层的像素值为m,雷达视频层的像素值为n,则像素点上的像素值为:p=λm+(1-λ)n,0≦λ≦1。

32.进一步优选地,第二次融合叠加对一次融合叠加层以及图形底层,按照一次融合叠加层在上层图形底层在下层的顺序进行叠加;叠加规则是一次融合叠加层中的所有黑色像素值在二次融合叠加时全部采用图形底层的像素点值替代;而非黑色像素点值保持不变。

33.总体而言,通过本发明所构思的以上技术方案与现有技术相比,具有以下

34.有益效果:

35.对于多信源异构视频的综合显示,传统的处理方式统一采用fpga处理,或通过cpu算力通过软件编程达到目的。前者通过fpga完成底图、雷达视频、标绘、鼠标以及光电视频等各种图形层的融合处理,统一叠加后再送给显示器显示,虽然fpga芯片具有多重并发处理、流水线机制以及灵活可定制等颇多优点,但是随着超高分辨率以及多路视频并行处理等集成功能的增多,其编译效率以及资源紧张等缺点显现出来,fpga最终编译出来的功能效果较差且稳定性不够。后者计算能力由于全部交由cpu处理,对其算力要求较高,会占用

较多的cpu资源,不仅弱化cpu对其它功能的处理能力,同时也会降低多窗口显示的时效性。

36.本发明采用fpga+arm架构的功能分离处理技术,fpga处理fc或万兆协议卸载、视频帧封装、雷达扫描转换、图层分离功能、一次融合叠加等功能;arm完成二次融合叠加、视频编解码以及视频综合处理等功能。采用fpga+arm架构模式,充分利用fpga的并行计算以及流水线处理能力,以及arm架构的低功耗高性能特点,不仅能够解决多路超高分辨率无压缩的fc视频(光电视频和雷达视频)和有压缩的网络视频的混合叠加显示功能,提升了显控台屏幕显示质量以及稳定性,也能够保证视频显示的强实时性能。

37.本发明同时也可以对混合窗口输出显示后的视频信息进行同步的编码输出到网络接口以实现数据共享,或通过网络接口接收网络视频流信息进行解码并将其叠加在图形界面上进行显示。相比较于传统的显控台图形界面共享功能解决方案,本方案可以减少一个编解码设备即可以满足网络数据共享的目的。

附图说明

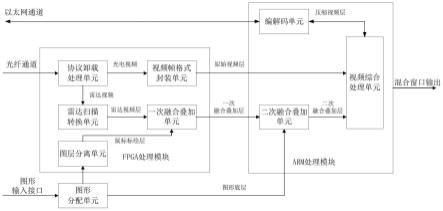

38.图1是本发明实施例提供的舰船系统多源异构视频处理显示装置的框图;

39.图2是本发明实施例提供的图形分配单元原理框图;

40.图3是本发明实施例提供的一次融合叠加处理原理框图;

41.图4是本发明实施例提供的二次融合叠加处理原理框图;

42.图5是本发明实施例提供的视频综合处理原理框图。

具体实施方式

43.为了使本发明的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本发明进行进一步详细说明。应当理解,此处所描述的具体实施例仅仅用以解释本发明,并不用于限定本发明。

44.一方面,如图1所示,本发明提供了一种舰船系统多源异构视频处理显示装置,包括:协议卸载单元、视频帧格式封装单元、雷达扫描转换单元、图形分配单元、图层分离单元、一次融合叠加单元、二次融合叠加单元、编解码单元和视频综合处理单元;其中,协议卸载单元、视频帧格式封装单元、雷达扫描转换单元、一次融合叠加单元和图层分离单元设置于fpga处理模块上,二次融合叠加单元、编解码单元和视频综合处理单元设置于arm处理模块上;该装置可接收来自光纤通道的无压缩的原始雷达视频数据或者红外/光电视频数据,根据本地显示需求,完成鼠标层、标绘层、图形层与雷达视频层的多层融合叠加处理,以及图形底层与一次融合叠加层、原始视频层、压缩视频层的多信源混合窗口叠加显示等功能。

45.(1)协议卸载单元

46.协议卸载单元的输入是外部接入的光纤通道;光纤通道作为载体可运行基于4.25g/8.5g速率的fc协议,或者是基于以太网协议的万兆网络,这两种协议可以根据用户需求进行在线动态加载;协议卸载单元作为与外界通信的功能单元,用于运行与维护协议栈;若运行的是fc协议,则支持fc-ae-asm协议,符合fc-fs以及gjb 6411-2008协议规范;如果运行的是万兆网协议,则兼容ieee802.3ae/ap协议,符合10gbase-sr协议规范;

47.更为具体地:

48.光纤通道传输的是多个无压缩的原始雷达视频与多个光电视频的混合视频,雷达

视频与光电视频通过不同的“组”以进行区分,多个雷达视频内或多个光电视频内又通过不同的“标记位”进行区分;对于fc协议,通过不同的sid以对雷达视频和光电视频进行区分;而对于万兆网则采用不同的组播地址以进行雷达视频与光电视频的区分;协议卸载单元对fc/万兆协议进行解析,获取payload视频数据,将雷达视频数据分发给雷达扫描转换单元,将光电视频数据分发给视频帧格式封装单元;各类视频帧格式描述如表1所示;

49.表1

[0050][0051]

(2)视频帧格式封装单元

[0052]

视频帧格式封装单元的输入端连接协议卸载单元,输出端连接视频处理单元;用于接收协议卸载单元传送的光电视频数据,将光电视频数据重封装,使其帧格式满足bt1120视频帧格式,也就是符合itu-r(国际电信联盟无线电通信部门)规定的数据结构,形成原始视频层;在此实施例中,以3840*2160分辨率举例来说,封装后的数据格式如表2所示:

[0053]

表2

[0054][0055]

(3)雷达扫描转换单元

[0056]

雷达扫描转换单元的输入端连接协议卸载单元,输出端连接一次融合叠加单元,用于对接收的雷达视频进行p显、b显和e显等多种模式的扫描转换,并进行ppi窗口、ar窗口、小窗口等各种窗口配置,以及余辉功能和ppi尾迹功能配置等操作,此时形成雷达视频层;

[0057]

更为具体地:雷达扫描转换单元首先完成雷达视频信号的扫描转换,根据上位机配置信息对雷达视频窗口的尺寸大小、位置信息、余辉、ppi尾迹和遮挡关系等进行预处理;

[0058]

(4)图形分配单元

[0059]

图形分配单元的输入端连接图形输入接口,输出端连接图层分离单元和二次融合叠加单元,用于将输入的差分串行视频信号并行化处理,一路转化为rgb888颜色值送给图层分离单元,一路转化为yuv422颜色值送到二次融合叠加单元;

[0060]

更为具体地,转化为rgb颜色空间的数据采用rgb888格式,红绿蓝每种颜色色深8bit,每个像素点由一个24bit数据组成;转化为bt1120数据格式的数据,是rgb888经过颜色空间变换,并采用插值法得到的一种yuv422数据格式;在本实施例中,图形分配单元需要根据后端各个单元的实际需求来分配不同的视频数据格式,发送给图层分离单元的数据为rgb888格式,每一个像素值不能有数据损失,且可完整的表示每一个像素点的三个颜色值;发送给二次融合叠加单元的数据为yuv222格式,符合二次融合叠加单元对接收数据的格式要求。rgb888和yuv222两种数据格式虽说颜色特征值不一样,但表征的是一个相同的图形信号;在本实施例中,图形分配单元原理框图如图2。

[0061]

(5)图层分离单元

[0062]

图层分离单元的输入端与图形分配单元相连,输出端与一次融合叠加单元相连,用于对图形分配单元输入的图形进行图层分离处理,提取出鼠标层和标绘层,同时丢弃掉海图层数据,此时形成鼠标标绘层;更为具体地,图层分离单元接收的是rgb888颜色空间数据,此数据包含了鼠标层、标绘层和海图层等多层信息,每一个图层信息用了不同的颜色空间集标识,其中,需要提取出鼠标层和标绘层,同时丢弃掉海图层数据;根据上位机设置的色键值,图层分离单元对每一个rgb888颜色值进行遍历判断,通过查找表的方式,筛选出上位机设定的色键值进行保留,获取鼠标层和标绘层;对不在查找表内的颜色值进行数据填0处理,使其表现为“黑色”像素,从而形成鼠标标绘层。处理后图层分离单元的输出仅保留了鼠标层和标绘层,它们的像素点位置信息以及颜色值均不改变,这样整帧图形层就只保留了鼠标和标绘信息,其余部分则表现为“黑色”数据(黑色层),此帧处理后的图形层如果送显示单元显示则会表现为整幅黑色画面上仅显示鼠标和标绘信息;以本实施例中采用的3840*2160分辨率图像中的一行数据来说,处理前数据如表3所示;

[0063]

表3

[0064]

列号123456

…

3837383838393840数据rgbrgb色键rgbrgbrgb

…

rgb色键rgbrgb

[0065]

处理后的数据如表4所示;

[0066]

表4

[0067]

列号123456

…

3837383838393840数据00色键000

…

0色键00

[0068]

(6)一次融合叠加单元

[0069]

一次融合叠加单元的输入与雷达扫描转换单元和图层分离单元相连,输出端与二次融合叠加单元相连,用于雷达视频层和鼠标标绘层的数据叠加和融合;

[0070]

更为具体地,一次融合叠加单元接收来自雷达扫描转换单元发送过来的雷达视频层和来自图层分离单元送过来的鼠标标绘层数据;一次融合叠加单元按照鼠标标绘层信息在上层、雷达视频层信息在下层的原则进行叠加处理;由于雷达视频层与鼠标标绘层分辨率一致,在叠加过程中,需要将两者的每一个像素值进行相应处理;

[0071]

更为具体地,一次融合叠加单元分别接收雷达扫描转换单元传送的雷达视频层以及图层分离单元送过来的鼠标标绘层,对这两层图形的每一个像素进行数据遍历判断处理。在同一位置像素点上,若鼠标标绘层的值为m,而雷达视频层的值为n,则此像素的值p根据此公式计算:p=λm+(1-λ)n,0≦λ≦1。处理后的完整数据帧叫做一次融合叠加层;λ的值可根据上位机指令来配置,以期达到数据融合后的不同效果;在本实施例中,一次融合叠加处理流程如图3所示;

[0072]

如果雷达视频层数据表示为rd,则叠加融合处理后的一次融合叠加层数据可表示如表5所示;

[0073]

表5

[0074]

列号123456

…

3837383838393840数据00色键00rd

…

0色键rd0

[0075]

(7)二次融合叠加单元

[0076]

二次融合叠加单元的输入端与一次融合叠加单元和图形分配单元相连,输出端与视频综合处理单元相连,用于将图形底层与一次融合叠加层再次融合叠加处理;更为具体地,一次融合叠加单元送过来的图层属于高优先级,需要置于叠加层的上层,一次融合叠加层包含的视频信息有鼠标层、标绘层、雷达层和“黑色层”,它们按照由上到下的层次进行排列;图形分配单元送过来的图形底层,将作为视频输出图形的最底层,所以在二次融合叠加时,会将一次融合叠加层叠于图形底层上;由于一次融合叠加层中的“黑色层”具有明显特征,它全部由数据0组成,所以在叠加处理时可根据此特征值,将“黑色层”的所有像素点值用图形底层的像素点值替代,非“黑色层”像素点值则保持不变,融合后的数据则会表现为一次融合叠加层中除了“黑色层”外的图层全部置于上层,“黑色层”则被图形底层替换后置于底层;在本实施例中,二次融合叠加处理流程如图4所示;

[0077]

在本实施例中,如果图形底层数据表示为pd,则二次融合叠加处理后的数据可表示为如表6所示;

[0078]

表6

[0079]

列号123456

…

3837383838393840数据pdpd色键pdpdrd

…

pd色键rdpd

[0080]

进一步优选地,视频综合处理单元进行显示时,由于二次融合叠加层包含了鼠标、标绘、雷达视频以及海图等图形信息,它始终是满屏显示的;而原始视频层以及压缩视频层则要根据上位机指令进行窗口大小以及位置信息的配置进行满屏或非满屏的显示。

[0081]

(8)编解码单元

[0082]

编解码单元对外连接以太网接口,对内连接视频综合处理单元。它主要负责接收以太网发送过来的视频码流进行解码,然后将解码后数据送给视频综合处理单元;同时它也接收视频综合处理单元送过来的叠加显示画面信息,并将其进行编码后通过网络发送出去,此时形成压缩视频层;

[0083]

编解码单元接收网络视频流信息,可同时对多达9路的1920*1080@30hz分辨率压缩码流进行解码处理,并将解码后的压缩视频层信息发送给视频综合处理单元进行相应的开窗显示;同时编解码单元亦可以接收混合窗口输出的画面进行编码处理后送入以太网通道。同时编解码单元可以根据用户要求通过上位机配置不同编码参数,例如h.264/h.265算法、码率、帧率等信息。

[0084]

(9)视频综合处理单元

[0085]

视频综合处理单元的输入端与二次融合叠加单元、视频帧格式封装单元以及编解码单元相连,输出端与显示单元相连。用于对接收到的二次融合叠加层、原始视频层以及压缩视频层进行视频叠加处理后进行混合窗口显示;更为具体地,视频综合处理单元将二次融合叠加层作为图形底层输出,输出的分辨率、帧率与输入的二次融合叠加层保持一致;视频综合处理单元进行显示时,由于二次叠加层包含了鼠标、标绘、雷达视频以及海图等图形信息,它始终是满屏显示的;而原始视频层以及压缩视频层则要根据上位机指令进行窗口大小以及位置信息的配置进行满屏或非满屏的显示。

[0086]

原始视频层与压缩视频层具有各自独立的视频信息,它们可以根据需要来调整各自的窗口位置、尺寸大小和叠加顺序等信息,将配置好的开窗画面叠加在图形底层上后送到显示终端进行显示;为了调整显示效果,可对输出视频的亮度、色度和对比度等参数进行

调整;在本实施例中,视频综合处理单元的原理框图如图5所示。

[0087]

另一方面,本发明提供了一种与舰船系统多源异构视频处理显示装置相应的舰船系统多源异构视频处理显示方法,包括以下步骤:

[0088]

s1:协议卸载单元用于根据配置的协议要求解析出光纤通道送过来的无压缩原始视频payload数据,并将光电视频数据送给视频帧格式封装单元,将雷达视频数据送给雷达扫描转换单元;

[0089]

s2:采用视频帧格式封装单元对光电视频数据进行bt1120视频帧格式的封装,形成原始视频层;

[0090]

s3:雷达扫描转换单元对接收到的雷达视频进行p显、b显和e显等多种模式的扫描转换,并进行ppi窗口、ar窗口等各种窗口进行位置尺寸的配置,以及余辉功能和ppi尾迹功能配置,形成雷达视频层;

[0091]

s4:图形分配单元将输入的图形信号进行颜色空间转换,一路转换为rgb888模式,一路转换为yuv422模式,此时形成图形底层;

[0092]

s5:图层分离单元提取出鼠标层和标绘层,同时丢弃掉海图层数据,形成鼠标标绘层;

[0093]

s6:一次融合叠加单元将s3和s5送过来的两种视频层信息进行叠加融合处理,形成一次融合叠加层;

[0094]

s7:二次融合叠加单元将s6和s4送过来的两种视频层信息进行再一次的叠加融合处理,形成二次融合叠加层;

[0095]

s8:编解码单元对接收到的以太网通道视频流数据进行解码,形成压缩视频层信息送到视频综合处理单元;

[0096]

s9:视频综合处理单元对接收到的二次融合叠加层、原始视频层以及压缩视频层进行视频叠加处理后进行混合窗口输出显示,可以根据需要以调整窗口位置、尺寸大小和叠加顺序等。为了调整显示效果,可对输出视频的亮度、色度和对比度等参数进行调整;

[0097]

s10:编解码单元接收混合窗口输出信息,对其进行编码处理后送到以太网通道。同时编解码单元可以根据用户要求通过上位机配置不同编码参数,例如h.264/h.265算法、码率、帧率等信息。

[0098]

本领域的技术人员容易理解,以上所述仅为本发明的较佳实施例而已,并不用以限制本发明,凡在本发明的精神和原则之内所作的任何修改、等同替换和改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1