基于机器学习及智能算法的垃圾通知过滤方法与流程

本发明涉及信息处理,特别涉及一种基于机器学习及智能算法的垃圾通知过滤方法。

背景技术:

1、随着科技的发展以及智能手机的普及,各种各样的垃圾广告已经渗透到移动设备的每个角落。尤其手机的通知是个垃圾通知泛滥的重灾区,这给予用户造成了不必要的干扰以及不良的体验,而目前手机系统的消息通知过滤功能相对来说比较简陋,需要用户自行过滤屏蔽通知,在应用比较多的场景中,由用户自行定制一款干净清爽的手机系统需要长时间的配置,因此有必要提供一种能够智能识别和过滤垃圾通知的机制。

2、手机系统现有的消息过滤机制存在以下问题:一是过滤功能简陋,目前的手机系统消息通知过滤功能相对简单,无法满足用户对高效过滤的需求。二是需要用户主动配置,目前的过滤功能需要用户手动过滤和屏蔽通知,耗费时间和精力。三是具有低过滤准确性,现有技术无法有效地识别和过滤垃圾通知,导致用户仍然受到大量干扰。

技术实现思路

1、本发明提供了一种基于机器学习及智能算法的垃圾通知过滤方法,利用预先构建的基于bert-bilstm-cnn的混合网络模型,能够自动识别和过滤那些对用户无用或者繁杂的通知,从而提高用户的体验和工作效率。

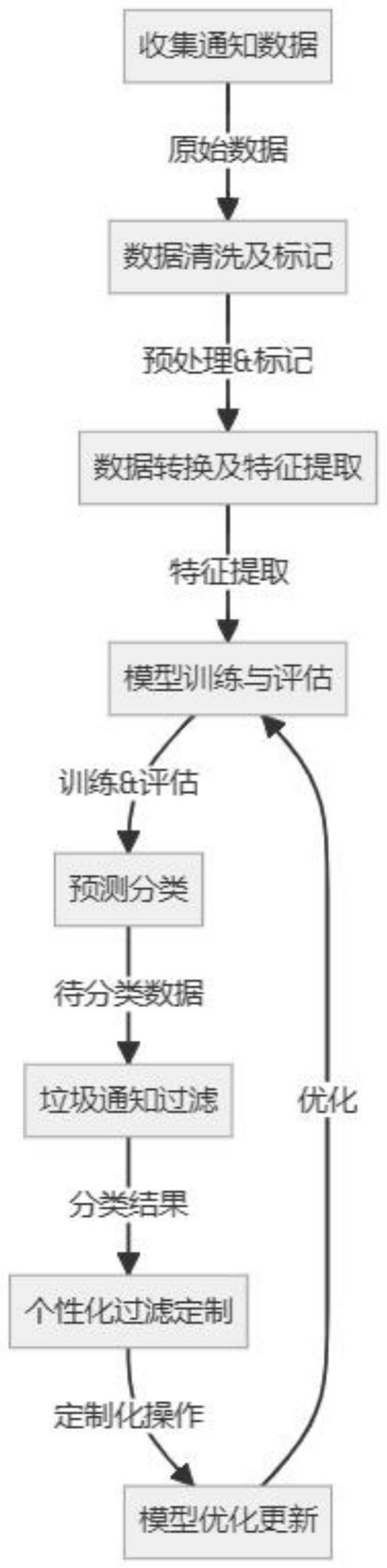

2、本发明提供了一种基于机器学习及智能算法的垃圾通知过滤方法,包括:

3、通过监测应用的通知信息,以采集原始通知数据;其中,所述通知数据包括通知标题、内容、发送应用;

4、对采集到的所述原始通知数据进行预处理以提取所述原始通知数据中的关键内容;其中,所述预处理包括清洗重复、错误、无用的信息;

5、将所述原始通知数据分为训练集和测试集,并对所述原始通知数据进行分类,以将正常通知标记为1,垃圾通知标记为0;

6、构建用于识别通知的基于bert-bilstm-cnn的混合网络模型,并利用所述训练集和测试集的数据对基于bert-bilstm-cnn的混合网络模型进行训练;其中,所述基于bert-bilstm-cnn的混合网络模型包括词向量表示模块和深层文本特征提取分类模块;

7、采集待分类的通知文本数据,并输入训练好的基于bert-bilstm-cnn的混合网络模型,得到通知分类结果;

8、根据所述通知分类结果和原始通知数据的标记结果对待分类通知进行判断,并当判断结果是垃圾通知时,统一过滤到垃圾通知回收箱以降低对用户的干扰。

9、进一步地,所述构建用于识别通知的基于bert-bilstm-cnn的混合网络模型,并利用所述训练集和测试集的数据对基于bert-bilstm-cnn的混合网络模型进行训练的步骤,包括:

10、对要进行分类的文本数据集进行预处理,得到输入文本,记为e=(e1,e2,…,ei,…,en),其中ei(i=1,2,…,n)表示文本的第i个字;

11、将所有的ei输入词向量表示模块,经过语言编码器transformer的编码后,将文本e进行序列特征化,输出文本wi=(w1i,w2i,…,wni),其中,wni示文本中第i句中的第n个词的词向量,将w1-wn词向量拼接(w1,w2,…,wn),得到bert词向量表示矩阵w;

12、将bert词向量输入深层文本特征提取分类模块,以输出所属的类别;其中,所述深层文本特征提取分类模块为bilstm-cnn模型。

13、进一步地,所述将所有的ei输入词向量表示模块,经过语言编码器transformer的编码后,将文本e进行序列特征化,输出文本wi=(w1i,w2i,…,wni)的步骤中,词向量表示模块为bert模型,其利用transformer架构的编码器部分构造多层双向的网络架构,transformer模型中的编码端由6个encoder组成,解码端由6个decoder组成;其中,每一个encoder的结构都是相同的,由输入、多头自注意力机制及全连接神经网络构成。

14、进一步地,所述将bert词向量输入深层文本特征提取分类模块,以输出所属的类别的步骤,包括:

15、输入bert词向量并经过2-gram、3-gram和4-gram等多个卷积核的卷积后,进一步提取文本中的关键特征和文本更深层的结构信息;

16、在池化层中对卷积层获得的每个特征图进行1-max pooling的特征映射处理得到统一的特征值,经过全连接层把池化后的特征连接起来,并进行softmax回归分类,生成最终的分类特征向量,最后输出所属的类别。

17、进一步地,所述将bert词向量输入深层文本特征提取分类模块,以输出所属的类别;其中,所述深层文本特征提取分类模块为bilstm-cnn模型的步骤中,

18、bilstm模型整体结构由两个方向相反的lstm以叠加的方式组成,正向lstm用于接收从前向后传递的信息状态,反向lstm用于接收从后向前的信息输入,在同一时刻将两个lstm的状态输出进行合并,作为bilstm当前时刻的输出,从而得到每一时刻的向量特征;

19、cnn模型为textcnn网络,textcnn网络结构由若干个卷积层、max pooling、全连接层和softmax层构成,采用不同尺寸的卷积核获取文本相邻的n-gram特征表示;其处理过程为:在卷积层使用多种尺寸的卷积核提取文本的局部特征,并将得到的特征向量输入池化层,通过下采样方式筛选重要特征信息,进而将经过1-max pooling处理后的特征向量拼接起来,再经过全连接层和softmax函数进行多分类。

20、进一步地,所述构建用于识别通知的基于bert-bilstm-cnn的混合网络模型,并利用所述训练集和测试集的数据对基于bert-bilstm-cnn的混合网络模型进行训练的步骤之后,还包括:

21、采用测试集评估基于bert-bilstm-cnn的混合网络模型的宏精确率、宏召回率和宏f1;其公式为:

22、

23、

24、

25、其中,macro-precision为宏精确率,表示每个类别精确率的算术平均值;macro-recall为宏召回率,表示每个类别召回率的算术平均值;macro-f1为宏f1,表示每个类别f1值的算术平均值。

26、进一步地,所述根据所述通知分类结果对通知进行判断,并当判断结果是垃圾通知时,统一过滤到垃圾通知回收箱以降低对用户的干扰的步骤之后,还包括:

27、用户预先设置过滤条件,包括放行白名单或者加入管制,基于bert-bilstm-cnn的混合网络模型将用户干预的通知信息加入到训练集后进行二次学习,以更新基于bert-bilstm-cnn的混合网络模型。

28、本发明还提供了一种计算机设备,包括存储器和处理器,所述存储器存储有计算机程序,所述处理器执行所述计算机程序时实现上述方法的步骤。

29、本发明还提供了一种计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现上述方法的步骤。

30、本发明的有益效果为:

31、本发明利用预训练模型bert对文本数据进行高纬度映射,得到嵌入向量,其次通过双层bilstm对输入文本的特征信息进行提取,可以获取全局上下文信息,再次经过textcnn对其中更深层的关键信息提取,最后经过softmax进行文本所属类别的预测,在本文对词向量转换过程保留了更多的语义语法信息,提高分类的准确率;最后根据预测的类别进行垃圾通知的标记和过滤;使得本发明能够智能识别并分类垃圾通知,提高过滤正确率,通过过滤的方式,阻止垃圾通知展示,提高用户的体验和工作效率。此外,用户可以在通知集中管理中进行设置(加入黑名单、放行白名单),实现个性化过滤定制,通过用户的反馈和行为数据,优化过滤模型,不断提高过滤准确性。

- 还没有人留言评论。精彩留言会获得点赞!