一种AR摄像头结合物联网系统的远程定位方法与流程

本发明涉及物联网设备控制领域,特别涉及一种ar摄像头结合物联网系统的远程定位方法。

背景技术:

1、随着智能制造的发展,工业机器人在复杂环境中的应用需求日益增长。但是传统机器人主要依赖自主导航进行定位,因环境变化大而难以实现高精度定位,无法满足对精确操控的需求。为实现机器人在复杂环境中的精确定位,迫切需要一种新型的定位与控制方案。

2、现有的机器人定位方法主要有激光雷达定位、视觉定位和惯导组合定位等。但激光雷达受场地影响大,视觉定位需事先建图且存在漂移问题,惯导组合定位累积误差大。这些方法难以做到机器人在复杂变化环境中得到实时精确定位。

3、在相关技术中,比如中国专利文献cn111885707a中提供了一种基于ar设备的物联网设备控制方法,包括通过ar设备中的动态uwb模块与物联网设备中的静态uwb模块相互通信;将ar设备在空间内沿预设轨迹移动,在移动ar设备时,通过uwb网络中传输的uwb信号计算ar设备与物联网设备之间的距离参数;在移动ar设备时,通过ar设备建立slam地图;通过距离参数生成物联网设备在slam地图中的坐标信息;通过ar设备基于坐标信息控制物联网设备。但是在该方案中,依赖单一uwb距离测量进行定位,容易受环境影响产生较大误差。在复杂环境中,uwb信号易受遮挡和多径效应影响,距离测量误差会增大。因此,在复杂环境中机器人的远程控制精度有待进一步的提高。

技术实现思路

1、针对现有技术中存在的复杂环境中机器人的远程控制精度低的问题,本发明提供了一种ar摄像头结合物联网系统的远程定位方法,通过ar技术和深度学习算法等,提高了机器人在复杂环境中的远程控制精度。

2、本发明的目的通过以下技术方案实现。

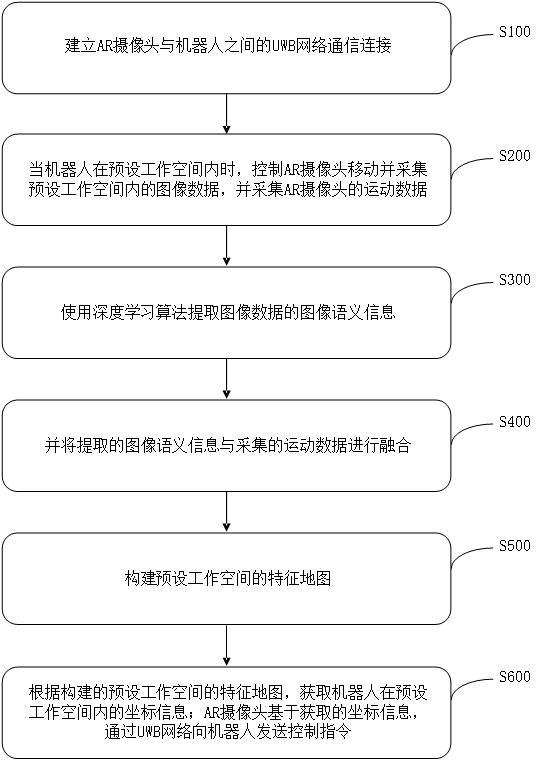

3、本说明书实施例提供一种ar摄像头结合物联网系统的远程定位方法,用于控制机器人,包括:建立ar摄像头与机器人之间的uwb网络通信连接;当机器人在预设工作空间内时,控制ar摄像头移动并采集预设工作空间内的图像数据,并采集ar摄像头的运动数据;其中,建立ar摄像头与机器人之间的uwb网络通信连接,作为机器人接收控制指令的通道;应用卷积神经网络等深度学习算法提取图像数据的语义信息,构建图像语义特征;将提取的图像语义特征与ar摄像头的运动数据进行匹配和融合,构建预设工作空间的初始特征地图;根据构建的特征地图,统计计算机器人在工作空间内的坐标信息;ar摄像头通过uwb网络,将计算出的机器人坐标信息发送给机器人,实现对机器人的远程定位;ar摄像头基于机器人坐标,经uwb网络向机器人发送控制指令,驱动机器人实现指定的工作。

4、使用深度学习算法提取图像数据的图像语义信息,并将提取的图像语义信息与采集的运动数据进行融合,构建预设工作空间的特征地图;其中,应用卷积神经网络等深度学习模型,作为语义分割算法,对输入的图像数据进行处理。卷积神经网络包含编码器和解码器结构。编码器通过卷积层提取图像的多层次语义特征。解码器受编码器输出的特征图控制,计算不同语义特征之间的相关性权重。根据特征图和权重参数,解码器输出图像的像素级语义信息,即图像语义分割信息。解析ar摄像头图像数据的元信息,提取图像语义信息的时间戳序列a。解析ar摄像头采集的运动数据,提取运动数据的时间戳序列b。建立seq2seq模型,以时间戳序列a和b为输入,输出匹配的时间索引序列。根据时间索引序列,匹配运动数据和对应的图像语义信息。将匹配的图像语义信息和运动数据作为节点,构建初始工作空间特征地图。

5、根据构建的预设工作空间的特征地图,获取机器人在预设工作空间内的坐标信息;ar摄像头基于获取的坐标信息,通过uwb网络向机器人发送控制指令。其中,在构建完成预设工作空间的特征地图后,确定地图内各个特征点的坐标。分析机器人当前图像,检测出机器人周围的特征点。将机器人周围特征点与特征地图进行匹配,统计计算匹配特征点的坐标。根据匹配特征点坐标的集中分布情况,计算机器人在地图坐标系内的具体坐标信息。ar摄像头获取到机器人的坐标信息后,根据运动控制算法规划机器人的目标路径。ar摄像头将控制指令中包含机器人目标路径点的坐标信息,通过uwb网络发送给机器人。机器人收到控制指令后,解析获得目标路径的坐标点信息。机器人按照控制指令移动到目标路径点上,实现精准定位和导航。

6、进一步地,构建预设工作空间的特征地图,还包括如下步骤:构建卷积神经网络作为语义分割网络,语义分割网络包含编码器和解码器;编码器对输入的图像数据进行卷积操作,提取图像特征,输出图像特征图;将图像特征图输入解码器,解码器通过构建二次核矩阵,计算特征之间的权重;解码器根据编码器输出的图像特征图和计算的权重,对图像特征图进行语义分割,生成图像语义信息。

7、其中,在本技术中,语义信息可以明确描述环境中不同对象类别,如过道、门口、架子等。这些关键对象对机器人导航和定位起着重要作用。利用语义信息可以提取这些关键场景元素作为特征点。特征点构成初始地图,可大幅提升机器人在复杂环境中的定位精度。语义信息还可以用于路径规划,避开障碍,实现智能导航。相比于传统视觉特征,语义信息与机器人任务更相关,更有利于知识表达。

8、进一步地,通过照度传感器采集预设工作空间的环境光照信息;将图像语义信息作为输入,其中图像语义信息包含每个像素的rgb值;建立图像语义信息的rgb值和环境光照信息之间的高斯过程回归模型;通过奇异值分解算法对高斯过程回归模型的协方差矩阵进行低秩逼近;利用低秩逼近后的高斯过程回归模型,结合环境光照信息,预测图像语义信息中每个像素的rgb值,生成调整后的图像语义信息。

9、其中,在本技术中,仓库内光照条件复杂多变,直接使用原始图像语义容易受光照影响。调整后语义可过滤环境光变化的影响,增强语义信息的鲁棒性。有利于从不同时段和位置获取的图像中提取可靠稳定的语义信息。使语义分割和特征提取更准确,减少光照变化引起的误差。基于调整后的语义可构建高精度的特征地图。有利于机器人在复杂光照条件下的持续精确定位。光照调整提高了语义信息在复杂环境中的适用性。使机器人能够在室内外等不同光照中可靠工作。

10、进一步地,生成调整后的图像语义信息,还包括:使用标定板采集不同光照值下图像数据中各像素的rgb值,建立光照值与rgb值之间的对应关系;计算每个像素的rgb值与对应的光照值之间的高斯过程回归系数;建立基于深度学习的条件pixel cnn模型,学习每个像素的光照响应先验知识;将高斯过程回归系数和光照响应先验知识作为输入,通过高斯过程回归模型,预测每个像素的rgb值;根据预测的rgb值,调整图像语义信息中每个像素的rgb值,生成调整像素后的图像语义信息。

11、其中,使用标定板采集不同光照条件下的图像,建立光照值与图像rgb值之间的对应关系。计算每个像素的rgb响应与对应光照值之间的高斯过程回归系数。构建基于pixelcnn的深度学习模型,学习像素对光照的响应先验知识。pixel cnn通过掩蔽卷积建模像素间依赖关系,输出光照响应的先验概率分布。将高斯过程回归系数和pixel cnn学习到的先验知识作为高斯过程回归模型的输入。高斯过程回归模型结合两者,输出每个像素在新光照下的rgb值高斯概率分布。根据rgb概率分布对每个像素采样,生成光照调整后的rgb值。将调整后的rgb值赋值给图像语义信息中对应的像素,完成图像的光照自适应调整。最终输出针对环境光照调整的图像语义信息。

12、进一步地,将提取的图像语义信息与采集的运动数据进行融合,包括:通过解析图像数据的元信息,提取图像语义信息的时间戳序列a;通过解析运动数据的时间戳,提取运动数据的时间戳序列b;建立基于lstm的seq2seq模型,将时间戳序列a和时间戳序列b作为输入,输出匹配后的时间索引序列;根据时间索引序列,匹配图像语义信息和运动数据的时间序列。

13、其中,在图像采集时,相机自动在图像文件中写入拍摄的时间元信息。读取图像文件,解析图像头信息,提取到图像的拍摄时间。对每张输入到语义分割网络的图像,都可以解析出一个唯一的拍摄时间。语言语义分割生成的图像语义信息,与对应的源图像时间信息相绑定。按时间顺序,组织所有图像语义信息的时间信息,形成时间戳序列a。时间戳序列a中,每个时间戳与一个图像语义信息对应。时间戳序列a反映了图像语义信息随时间的变化顺序。时间戳序列a将与运动时间序列b对齐,用于匹配语义信息和运动数据。

14、其中,运动数据来源于机器人上的惯性传感器,如加速度计、陀螺仪等。这些传感器以一定频率持续采集机器人的运动数据。在运动数据采集模块中,配合传感器采样,持续记录数据的时间戳。时间戳使用系统时钟生成,精确到毫秒级。将每个运动数据样本与其采集时间时间戳对应绑定。按时间顺序组织所有运动数据时间戳,构成时间序列b。时间序列b中每个时间戳对应一次运动数据采样。时间序列b反映了机器人运动数据随时间的变化。时间序列b与图像时间序列a对齐,用于匹配运动和语义信息。

15、进一步地,还包括:利用匹配后的时间索引序列,获取对应时间索引的图像语义信息;将获取的对应时间索引的图像语义信息输入imm运动模型,预测对应图像采集时刻的运动位置;将预测的运动位置与对应时间索引的图像语义信息,通过建立匹配表进行配对。其中,输入经seq2seq模型匹配后的时间索引序列i。根据每个时间索引ii,在对齐后的图像语义序列中取出对应图像语义信息ai。构建imm(互动多模型)算法的运动预测模型。imm模型集成多个运动动力学模型和数据驱动模型。输入时间索引ii到imm模型,预测该时刻的运动状态和位置pi。利用匹配时间索引ii,建立表格,匹配语义信息ai和预测位置pi。重复该匹配过程,得到全部时间索引对应的图像语义信息和运动预测。最终得到匹配表,每行为一个时间索引,对应的语义信息与运动预测。匹配表整合了图像语义理解和运动预测的时空信息。

16、进一步地,在预测对应图像采集时刻的运动位置之后,还包括:获取与预测的运动位置通过匹配表配对的对应的图像语义信息;将获取的图像语义信息和对应的预测的运动位置作为节点,构建八叉树进行最近邻搜索;遍历搜索八叉树,选择节点间欧式距离最小的图像特征和运动位置进行对齐融合;其中,已构建匹配表,存储图像语义信息ai和对应预测运动位置pi。输入待匹配的新图像语义信息an和运动位置预测pn。在匹配表中搜索语义信息an的最近邻ai,得到配对的位置pi。利用an和pi构建一个新节点,插入到八叉树中。在八叉树中,节点特征为图像语义信息向量。从新插入节点开始,遍历八叉树进行最近邻搜索。计算新节点与已有节点之间的特征欧式距离。选择与新节点欧式距离最小的已有节点。取出该最近邻节点存储的图像语义和对应运动位置。将最近邻图像语义和运动位置与新节点的an和pn进行融合。最终得到与新数据匹配的图像语义和运动规划信息。

17、进一步地,在选择节点间欧式距离最小的图像特征和运动位置进行对齐融合之后,还包括:获取选择的图像特征的像素坐标作为特征点;根据特征点和对应的运动位置,构建扩展卡尔曼滤波ekf slam模型;设置扩展卡尔曼滤波ekf slam模型的状态变量包含机器人的位置和特征点的位置;根据扩展卡尔曼滤波ekf slam模型的预测更新,迭代优化特征点的位置,生成预设工作空间的初始特征地图。

18、其中,已选择图像特征最小欧式距离的节点,获得图像语义特征和对应运动位置。从语义特征中提取像素坐标作为特征点。构建ekf slam模型,状态变量包含机器人位置和所有特征点位置。运动模型预测机器人位置,测量模型根据特征观测更新特征点位置。设置观测矩阵根据当前特征点对其他特征点的相对观测。ekf按时间顺序迭代进行预测和更新,优化所有特征点位置。利用匹配到的语义特征和运动轨迹作为ekf的先验输入。迭代ekfslam后得到初始特征地图,表示环境特征点分布。后续可继续增量优化地图,用于机器人自主导航。

19、进一步地,在生成初始特征地图之后,还包括:构建递归贝叶斯滤波模型,以初始特征地图为观测输入;将初始特征地图中每个像素坐标作为递归贝叶斯滤波模型的状态变量;根据递归贝叶斯滤波模型的预测方程和更新方程,迭代优化每个状态变量;输出迭代优化后的状态变量构成的最终的特征地图。

20、其中,输入已构建的初始特征地图,包含特征点的位置分布。构建递归贝叶斯滤波模型,状态变量为地图中的每个特征点。预测方程根据现有地图特征预测特征点位置分布。更新方程融合实际特征观测,修改预测的特征点状态。将初始地图特征作为递归滤波的第一轮输入。迭代递归预测和更新过程,逐步优化每个特征点状态。优化目标是减小特征点位置的方差,提高定位精度。重复迭代直到特征点状态足够稳定。最终迭代得到的特征点状态构成优化后的最终特征地图。地图作为知识表示,可支持机器人的自主任务与决策。

21、进一步地,递归贝叶斯滤波模型采用一阶马尔可夫过程。其中,一阶马尔可夫过程(first-order markov process):一种随机过程,其中未来状态只依赖当前状态,与过去状态无关。具有无后效性的性质。具体地,递归贝叶斯滤波假设状态转移具有马尔可夫性质。即特征点的下一时刻状态仅依赖当前状态。在预测步骤中,根据当前特征点状态计算转移概率。生成下一时刻特征点位置的预测分布。在更新步骤中,根据最新观测修正预测分布。依次递归进行预测和更新过程。利用马尔可夫假设简化递归运算。最终输出优化后的特征点状态构建地图。

22、相比于现有技术,本发明的优点在于:

23、(1)通过构建卷积神经网络进行图像语义分割,提取图像的语义信息,提高了图像信息的表达能力,为后续特征地图的构建提供了丰富的语义特征描述,这避免了传统方法直接使用图像像素信息导致的语义不明确的问题;

24、(2)利用递归贝叶斯滤波模型对初始特征地图进行优化,设置每个像素坐标为状态变量,根据预测和更新方程迭代优化,提高了特征地图的精度,这克服了普通滤波方法无法有效消除特征地图累积误差的缺点;

25、(3)借助八叉树近邻搜索算法,实现图像语义信息和对应的运动数据的最优匹配,避免了全局搜索造成的大量计算量,这解决了图像和运动数据时间序列匹配的低效问题;

26、综上所述,本技术通过深度学习算法提取图像语义信息,将图像语义信息与机器人运动数据进行融合,构建工作空间特征地图,再利用该特征地图实时定位机器人,并通过物联网网络发送控制指令,从而实现了机器人在复杂环境中的精确远程定位和控制。

- 还没有人留言评论。精彩留言会获得点赞!