一种基于时空特征融合的实时动作识别方法

1.本发明结合深度学习与计算机视觉算法,具体公开了一种基于时空特征融合的实时动作识别方法。

背景技术:

2.随着视频获取设备和网络的发展,从视频信息中分析和理解人体动作变得越来越重要。人体动作识别应用于视频监控、自动视频标签和人机交互等多个领域。动作识别在模式识别当中属于比较困难的识别任务,识别视频中的动作则是其中一个充满挑战而又具有较高实际应用价值的任务。相比图像来说,视频内容和背景更加复杂多变,不同的动作类别之间具有相似性,而相同的类别在不同环境下又有着不同的特点。

3.根据实现的方法来分类,可以把人体动作识别分为基于单帧图像的动作识别和基于视频的动作识别。相比于基于视频的识别,基于单帧图像的识别优势在于图像更容易获得,可是由于图像没有时间信息识别起来更加困难,并且也更容易出现误判。而基于视频的动作识别能够有效的获取视频中的时间和空间信息,这在很大程度上提高了识别的准确率。现有的人体动作识别方法主要有基于特征提取的动作识别方法和基于深度学习的动作识别方法。传统基于特征提取的动作识别方法主要靠一些经典的人为设计特征来提取运动特征,再由分类器分类或进行模板匹配。人工设计特征数据预处理复杂,而深度学习模型具有自适应学习特征、数据预处理简单等优点。

4.现在的方法多是通过深度学习的方法进行特征提取,但是采用二维卷积神经网络的方法缺少对时间域特征的提取,采用三维卷积神经网络的方法存在过拟合,参数量过大的问题。

5.因此,结合深度学习与计算机视觉的方法,构建一种更便利的动作识别方法是非常必要的。

技术实现要素:

6.本发明的目的在于提出一种基于时空特征融合的实时动作识别方法,其采用如下方案:

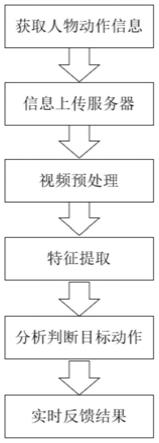

7.一种基于时空特征融合的实时动作识别方法,包括如下步骤:

8.s1、通过摄像头获取人物动作的视频信息;

9.s2、将获取人物动作的视频信息上传到服务器;

10.s3、对上传的视频进行预处理,进行等间隔的分帧;

11.s4、使用动作检测器,对视频信息进行特征提取,使用时空特征融合方法,对视频信息进行时间域与空间域特征融合,完成特征提取;

12.s5、使用深度学习的方法,对特征进行综合分析,判断目标动作;

13.s6、将结果实时反馈。

14.进一步,上述步骤s1中,通过调整摄像头角度,实时地捕获目标人物的动作特征信

息。

15.进一步,上述步骤s2中,需要将对于s1中获取到的信息每隔一定时间上传到指定的服务器中,分析所处动作状态。

16.进一步,上述步骤s3中,通过视频分帧技术,根据深度学习算法中时间步长,每秒提取16张视频帧图片。

17.进一步,上述步骤s4中,完成对于时空特征融合的特征提取。

18.进一步,数据处理的具体步骤为:

19.s41、通过动作检测器,在步骤s3的基础上,完成对于每一帧图片目标动作的空间域特征提取工作;

20.s42、通过时空特征融合方法,在步骤s41的基础上,实现时间域与空间域特征的融合;

21.s43、通过高斯核函数,在步骤s42的基础上,完成对时空特征正则化,提高特征的高效性;

22.进一步,上述步骤s5中,根据s4中的特征提取结果进行分析处理,送入深度学习分类其中进行目标人物的动作状态的判别。

23.进一步,上述步骤s6中,根据s5中的分析结果实时的反馈待目标人物的动作状态。

24.本发明具有如下优点:

25.本发明方法通过深度神经网络与计算机视觉的方法,在二维神经网络架构中,加入了三维池化层,创造性地融合了时空特征,并且加入了高斯核函数来对特征进行扰动,增强特征的高效性,采用二维卷积提取特征,大大缩短了算法处理时间,使得识别目标人物的动作更加高效快捷,相较于二维卷积的方法,考虑了时间域的特征,相较于三维卷积的方法,参数量小运行速度快。

附图说明

26.图1为本发明中一种基于时空特征融合的实时动作识别方法的流程框图。

27.具体实施方法

28.下面结合附图以及具体实施方式对本发明作进一步详细说明:

29.结合图1所示,一种基于时空特征融合的实时动作识别方法,包括如下步骤:

30.s1、获取人物动作的视频信息

31.为了充分获取目标人物的动作特征信息,本方法要合理的调整摄像头的角度,从而使得目标人物的信息能够被摄像头充分的捕捉到。

32.s2、将获取人物动作的视频信息上传到服务器

33.完成对于目标人物动作状态的实时获取,由于本地的硬件环境可能不满足数据处理的需要,为了实时的目标人物动作的状态变化,本方法每隔一小段时间需要完成数据的上传以便进行疲劳的检测。

34.s3、对上传的视频进行预处理,进行等间隔的分帧,转化为标准的数据形式;

35.由于上传到服务器的是一段完成的视频,而如果对完整的视频进行检测会大大增加检测的复杂性,为此,通过视频分帧技术,将视频进行分帧,具体为每秒提取16帧,并将其转化为标准的数据形式。

36.s4、对等间隔的帧做进一步处理,提取特征;

37.为了充分提取目标人物动作的所有视觉特征,本方法考虑时间域以及空间域特征对于动作识别的影响,构建了时空特征融合的特征提取架构。

38.s41、在架构的底层,考虑空间域对于目标动作识别状态的影响,本方法使用resnet

‑

50为基础框架预训练动作检测器,在挑选帧的基础上检测动作特征;

39.s42、在步骤s41的基础上,在每两层网络后加入一个三维池化层,实现时间域与空间域特征的融合,提高在时间维度上,不同时间步的关注度,提高特征的高效性;

40.s43、通过高斯核函数,在步骤s42的基础上,完成对时空特征正则化,,提高在不同频率特征的关注度;

41.s44、通过特征融合技术,融合步骤s41与步骤s43提取的特征。

42.通过以上操作,完成对于当前数据的特征提取工作。

43.s5、基于深度神经网络模型,对特征进行综合分析,判断目标动作

44.根据之前的数据处理得到的特征,对特征进行处理分析,采用softmax分类器对目标人物进行动作判别。

45.s6、完成对于当前目标人物动作检测的分析工作,并实时反馈。

46.当然,以上说明仅仅为本发明的较好实施例子,本发明并不限于列举上述实施例,应当说明的是,任何熟悉本领域的技术人员在本说明书的教导下,所做出的所有等同替代、明显变形形式,均落在本说明书的实质范围之内,理应受到本发明的保护。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1